Integrar la Inteligencia Artificial (IA) en el análisis de datos se ha convertido en una prioridad estratégica para las organizaciones que buscan transformar sus forma de operar y obtener una ventaja competitiva.

El entusiasmo generado por los avances en modelos de IA generativa ha capturado la atención de ejecutivos y consumidores por igual, pero la realidad nos muestra que implementar y escalar la IA de manera exitosa trae consigo una serie de desafíos significativos, que no son puramente tecnológicos, sino que están profundamente arraigados en la estrategia de datos, la gobernanza, la cultura organizacional y la gestión del talento.

¿Cuáles son estos desafíos?

Desafíos relacionados con los propios datos

Antes de siquiera pensar en modelos sofisticados, necesitamos asegurarnos de la disponibilidad y la calidad de los datos. Sin una base de datos sólida, incluso los modelos de IA más avanzados no pueden funcionar de manera efectiva. Los desafíos en esta área son a menudo la causa principal de la desilusión y el fracaso de los proyectos.

Calidad y consistencia de los datos

El análisis de datos se rige por el principio de «si entra basura, sale basura» (“garbage in, garbage out”), lo que significa que la calidad de los datos es crucial para el éxito de los modelos de IA. Una gran mayoría de los proyectos de IA fracasan, principalmente debido a problemas con los datos, lo que resulta en una falta de retorno de inversión medible.

La limpieza y preparación de datos representa un coste significativo, a menudo hasta el 30% del total del proyecto. Pero es un coste necesario, porque la mala calidad de los datos puede propagarse y amplificarse en ecosistemas de IA interconectados, convirtiéndose en un riesgo sistémico que compromete la toma de decisiones.

Por lo tanto, el éxito a largo plazo de la IA dependerá no tanto de la supremacía algorítmica, sino de la excelencia en los datos y una gobernanza robusta.

Acceso, silos y la lucha por la integración

Para que la IA genere valor, necesita datos completos y conectados. Sin embargo, muchas empresas luchan con silos de datos, donde la información está compartimentada en bases de datos dispares y sistemas heredados.

Esta fragmentación impide una visión unificada y limita la capacidad de los modelos de IA para un análisis preciso. Además, la escasez de datos propios agrava el problema, dificultando la personalización y diferenciación de los modelos. La lucha contra los silos no es solo técnica, sino una barrera organizacional que impacta la calidad y el valor de los datos, impidiendo una gobernanza eficaz.

Sin una gobernanza adecuada, se compromete la fiabilidad del modelo de IA, creando un círculo vicioso de fragmentación que lleva a la mala calidad y, en última instancia, al fracaso del proyecto. Por ello, la solución a la mala calidad no es solo limpiar los datos, sino romper los silos para permitir una integración fluida y una gobernanza unificada.

Desafíos éticos, de gobernanza y de confianza

A medida que la IA se vuelve más poderosa y autónoma, los desafíos éticos y de gobernanza se convierten en preocupaciones centrales para empresas y reguladores. La capacidad de los modelos para tomar decisiones sin supervisión, junto con su dependencia de datos históricos, plantea riesgos significativos para la equidad, la privacidad y la confianza.

El sesgo y la discriminación: reflejo de prejuicios

El sesgo en la IA, entendido como una discriminación sistemática incorporada en los modelos, es una de las mayores preocupaciones éticas. Casi la mitad (45%) de los ejecutivos encuestados por IBM expresan preocupación por la precisión o el sesgo de los datos. El riesgo radica en que los modelos de IA, al aprender de datos existentes, pueden perpetuar y amplificar los prejuicios y estereotipos presentes en la sociedad.

No existe una razón única por la que se produce el sesgo, sino que las causas suelen ser múltiples y complejas:

- Sesgo de datos: ocurre cuando los conjuntos de datos de entrenamiento no son representativos o contienen sesgos históricos. Un ejemplo común es un algoritmo de calificación crediticia que penaliza a los solicitantes de vecindarios de bajos ingresos, lo que resulta en tasas de rechazo más altas para ciertos grupos socioeconómicos o raciales.

- Sesgo algorítmico: surge cuando el diseño del algoritmo introduce el sesgo de manera inadvertida, incluso si los datos son imparciales.

- Sesgo de decisión humana: refleja los prejuicios cognitivos de los equipos de desarrollo que se filtran a través del etiquetado de datos o el diseño del modelo.

- Sesgo de IA generativa: los modelos de IA generativa pueden heredar y reforzar estereotipos de sus datos de entrenamiento, por ejemplo, al subrepresentar a ciertos grupos raciales o culturales en las imágenes que producen.

Los efectos de estos sesgos se manifiestan en la vida real con implicaciones serias, desde la discriminación en la contratación de personal o en los diagnósticos médicos hasta las prácticas sesgadas en la aplicación de la ley. Para mitigar estos riesgos, las organizaciones deben priorizar la gobernanza, la transparencia y la ética de la IA.

Privacidad y seguridad

El manejo de grandes volúmenes de datos sensibles, especialmente los recolectados de fuentes públicas, presenta desafíos significativos en cuanto a privacidad y seguridad, siendo la protección de datos una barrera clave para la adopción de la IA.

Además, la proliferación de la IA en la sombra, donde empleados de empresas privadas usan herramientas como ChatGPT sin supervisión, crea vulnerabilidades de seguridad al exponer información confidencial a modelos públicos.

Esto resalta la urgencia de una gobernanza de datos madura, con segregación de documentos y políticas claras sobre el uso de la IA. El cumplimiento normativo, como el RGPD, ya incorpora secciones específicas para la IA, convirtiendo la protección de datos en un imperativo legal.

Transparencia y explicabilidad

La creciente complejidad de los modelos de IA genera una falta de transparencia que erosiona la confianza y representa un riesgo inaceptable para sectores regulados —banca, salud, justicia…—, dificultando su adopción. Para superar esta barrera, la IA Explicable (XAI) surge como un conjunto de técnicas que buscan abrir la «caja negra» de las decisiones de IA, haciéndolas comprensibles para los humanos.

Más allá de lo técnico, la XAI es fundamental para el éxito empresarial, ya que aumenta la confianza de usuarios y stakeholders, mitiga el sesgo y garantiza el cumplimiento normativo. Al superar la resistencia cultural y demostrar la integridad y equidad del sistema, la aplicación de XAI transforma un riesgo de confianza en una ventaja competitiva.

Desafíos organizacionales y estratégicos

Los obstáculos más significativos para la adopción de la IA no se encuentran en la tecnología en sí, sino en la capacidad de las organizaciones para gestionar el cambio, invertir estratégicamente y asegurar el talento necesario.

La gran brecha: escasez de talento y habilidades

La escasez global de profesionales cualificados en ciencia de datos y análisis es una de las barreras más significativas para la adopción de la IA, lo que ha elevado los salarios y ha convertido la ciencia de datos en uno de los trabajos más solicitados, retrasando la adopción y limitando la competitividad empresarial de las empresas medianas.

Ante este dilema, las organizaciones pueden optar por desarrollar talento interno, lo cual es costoso y lleva tiempo, o adquirir experiencia externa, lo que, si bien ofrece éxito inicial, conlleva el riesgo de una pérdida de conocimiento interno a largo plazo, dejando a la organización vulnerable e incapaz de evolucionar sus sistemas de IA.

La decisión clave no es solo cómo adquirir talento, sino cómo desarrollar una capacidad sostenible para gestionar y evolucionar la IA.

Falta de justificación de negocio y ROI

A pesar del alto nivel de experimentación, el entusiasmo por la IA no siempre se traduce en valor de negocio tangible. Según un estudio sobre IA del MIT, el 95% de los proyectos piloto de IA generativa no logran generar retornos de inversión medibles y se quedan atascados en la fase experimental.

El problema de estos proyectos es en realidad una incapacidad para escalar la solución de la fase de concepto a un despliegue a nivel de producción que genere eficiencias o ingresos.

Las razones de esta brecha son en gran medida estratégicas y de gestión. Las causas principales incluyen:

- Objetivos comerciales mal definidos: la falta de una meta clara y realista desde el inicio del proyecto conduce a iniciativas que no resuelven un problema significativo para el negocio.

- Desajuste estratégico en los presupuestos: las empresas a menudo invierten en áreas de bajo retorno, como ventas y marketing, a pesar de que la evidencia sugiere que las mayores eficiencias se encuentran en la automatización administrativa y la optimización de procesos operativos.

- Ignorar la fase de post-despliegue: muchas organizaciones cometen el error de pensar que el proyecto termina una vez que el modelo se ha desplegado. Sin embargo, el trabajo de monitorización, mantenimiento y adaptación continua es crucial para que el modelo siga siendo relevante y preciso.

Resistencia cultural y de liderazgo

Los proyectos de IA no son simplemente implementaciones tecnológicas; son iniciativas de gestión del cambio que requieren una transformación cultural integral de toda la organización. Un estudio de Deloitte sobre IA revela que solo el 3% de los ejecutivos consideran que su empresa está preparada para adoptar el desarrollo interno de la Inteligencia Artificial.

La resistencia al cambio surge de la falta de una comunicación clara y transparente sobre el proceso de adopción, lo que puede generar temores y conceptos erróneos entre los empleados. A menudo, la adopción se ve limitada por una falta de liderazgo que no logra alinear la estrategia tecnológica con los objetivos de negocio.

El fenómeno de la IA en la sombra es un síntoma de este problema, ya que los empleados adoptan herramientas por su cuenta para aumentar la productividad sin una estrategia o dirección clara por parte del liderazgo.

Fomentar una cultura de innovación, comunicación abierta y aprendizaje continuo es fundamental para que la IA sea aceptada y utilizada de manera efectiva.

El coste real de implementación

El coste de desarrollar e implementar una solución de IA es una barrera significativa, que puede variar ampliamente desde un proyecto básico de menos de 10.000€ hasta un proyecto complejo que supera los 300.000€ (o incluso millones, según alcance y dimensión de la empresa).

Un error común es subestimar los costes totales, lo que lleva a iniciativas sin la financiación adecuada y, en última instancia, al fracaso del proyecto.

El coste de un proyecto de IA va mucho más allá de la simple adquisición de software o hardware. Un presupuesto de los gastos involucrados debería incluir partidas como:

- Recopilación y procesamiento de datos: adquisición y preparación de datos, así como costes de computación en la nube. La mala calidad de la información puede inflar innecesariamente estos costes.

- Gestión del proyecto: costes asociados a la planificación y coordinación de la iniciativa.

- Contratación de personal: el coste más elevado, que incluye salarios de científicos de datos, ingenieros y personal no técnico.

- Pruebas y mantenimiento: costes recurrentes para monitorizar, actualizar y asegurar el funcionamiento del modelo a largo plazo.

- Compliance legal: asesoría legal, privacidad, ciberseguridad y certificaciones para garantizar el cumplimiento con las diferentes normativas.

Conclusiones y recomendaciones estratégicas

La aplicación de la Inteligencia Artificial al análisis de datos no es una panacea, sino una iniciativa estratégica compleja que demanda una planificación rigurosa y un entendimiento profundo de sus múltiples desafíos.

Los obstáculos más críticos no son la tecnología misma, sino la madurez de la organización para gestionar sus datos, su talento, su cultura y su estrategia. La calidad de los datos es la base, la gobernanza, ética, talento y cultura, los habilitadores. Un fracaso en cualquiera de estas áreas puede comprometer el éxito de toda la iniciativa.

Para superar estos retos y generar un valor de negocio tangible, propongo las siguientes recomendaciones estratégicas:

- Priorizar la excelencia en los datos y la gobernanza: antes de invertir en modelos avanzados, las organizaciones deben enfocar sus esfuerzos en resolver los problemas de calidad, integración y acceso a los datos. Es esencial establecer un marco de gobernanza maduro que supervise el ciclo de vida completo de los datos, desde la adquisición hasta la utilización, lo cual permitirá garantizar la precisión, la privacidad y la equidad.

- Enfocarse en la justificación de negocio y el ROI: en lugar de perseguir pilotos de bajo impacto o casos de uso populares, las empresas deben identificar y priorizar iniciativas de IA que resuelvan problemas de negocio reales y que ofrezcan un retorno de inversión medible en áreas de alto impacto, como la automatización administrativa y la eficiencia operativa.

- Invertir en transparencia y confianza: las organizaciones deben adoptar proactivamente la IA explicable y transparente como una ventaja competitiva. Al abrir la «caja negra» de sus modelos, pueden mitigar los riesgos de sesgo, cumplir con las normativas, y lo más importante, construir la confianza de los empleados y los stakeholders, superando uno de los mayores impedimentos culturales para la adopción.

- Desarrollar una estrategia de talento sostenible: la decisión no es simplemente «construir o comprar» talento. La estrategia debe ser un equilibrio entre la velocidad de la externalización y la necesidad de desarrollar una capacidad interna sostenible. Las colaboraciones con socios tecnológicos deben incluir un plan claro de transferencia de conocimiento para que la organización no se vuelva dependiente y pueda mantener y evolucionar sus modelos a largo plazo.

- Gestionar la IA como un proyecto de cambio cultural: el liderazgo debe ver la IA como un catalizador de transformación organizacional, no solo como una herramienta tecnológica. Esto implica fomentar una cultura de toma de decisiones basada en datos, promover la comunicación transparente y educar a los empleados para mitigar la resistencia al cambio.

En conclusión, el éxito de la IA en el análisis de datos no se medirá por la sofisticación de sus algoritmos, sino por la madurez de las organizaciones para superar los retos fundamentales que residen en la intersección de los datos, la gobernanza, la ética y la estrategia de negocio.

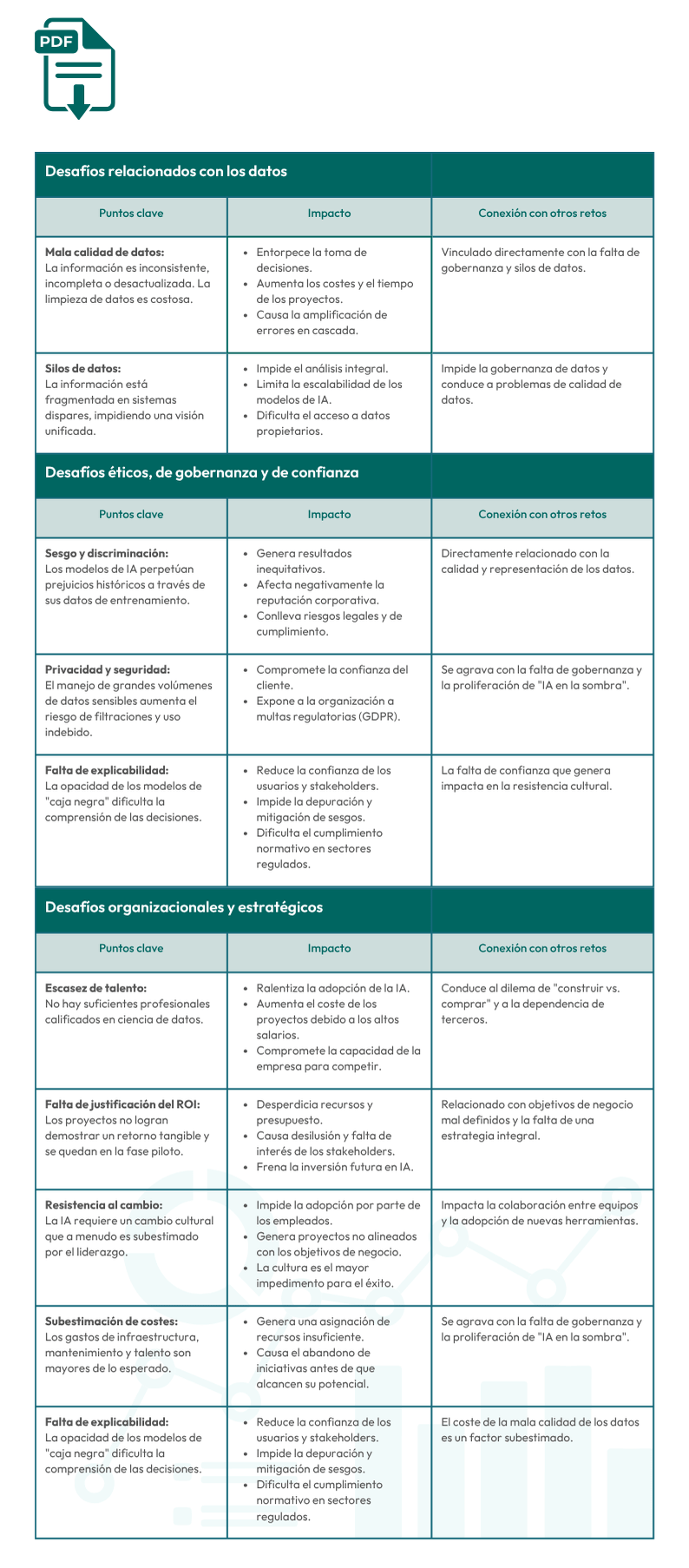

Desafíos críticos y su impacto estratégico

A continuación, encontrarás un resumen de los retos tratados en el post y su impacto en la estrategia organizacional. Haz clic en la imagen para descargártela y consultarla cuando lo necesites o compartirla con tu equipo como guía de referencia.